前段时间,一条指出谷歌大脑团队论文《Attention Is All You Need》中 Transformer 构架图与代码不一致的推文引发了大量的讨论。

对于 Sebastian 的这一发现,有人认为属于无心之过,但同时也会令人感到奇怪。毕竟,考虑到 Transformer 论文的流行程度,这个不一致问题早就应该被提及 1000 次。

Sebastian Raschka 在回答网友评论时说,「最最原始」的代码确实与架构图一致,但 2017 年提交的代码版本进行了修改,但同时没有更新架构图。这也是造成「不一致」讨论的根本原因。

随后,Sebastian 在 Ahead of AI 发布文章专门讲述了为什么最初的 Transformer 构架图与代码不一致,并引用了多篇论文简要说明了 Transformer 的发展变化。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

以下为文章原文,让我们一起看看文章到底讲述了什么:

几个月前,我分享了《Understanding Large Language Models: A Cross-Section of the Most Relevant Literature To Get Up to Speed》,积极的反馈非常鼓舞人心!因此,我添加了一些论文,以保持列表的新鲜感和相关性。

同时,保持列表简明扼要是至关重要的,这样大家就可以用合理的时间就跟上进度。还有一些论文,信息量很大,想来也应该包括在内。

我想分享四篇有用的论文,从历史的角度来理解 Transformer。虽然我只是直接将它们添加到理解大型语言模型的文章中,但我也在这篇文章中单独来分享它们,以便那些之前已经阅读过理解大型语言模型的人更容易找到它们。

On Layer Normalization in the Transformer Architecture (2025)

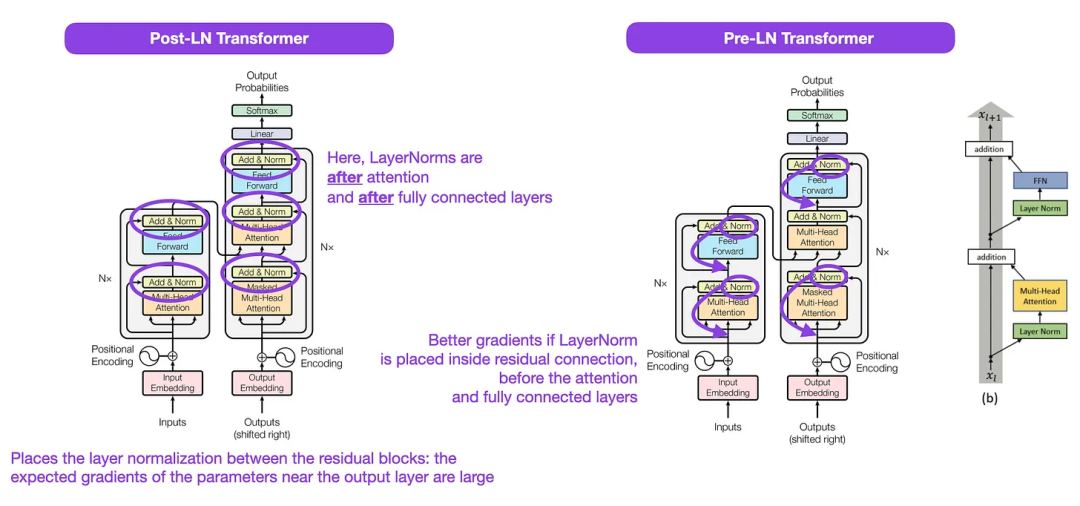

虽然下图(左)的 Transformer 原始图(https://arxiv.org/abs/1706.03762)是对原始编码器 - 解码器架构的有用总结,但该图有一个小小的差异。例如,它在残差块之间进行了层归一化,这与原始 Transformer 论文附带的官方 (更新后的) 代码实现不匹配。下图(中)所示的变体被称为 Post-LN Transformer。

Transformer 架构论文中的层归一化表明,Pre-LN 工作得更好,可以解决梯度问题,如下所示。许多体系架构在实践中采用了这种方法,但它可能导致表征的崩溃。

因此,虽然仍然有关于使用 Post-LN 或前 Pre-LN 的讨论,也有一篇新论文提出了将两个一起应用:《 ResiDual: Transformer with Dual Residual Connections》(https://arxiv.org/abs/2304.14802),但它在实践中是否有用还有待观察。

图注:图源 https://arxiv.org/abs/1706.03762 (左 & 中) and https://arxiv.org/abs/2002.04745 (右)

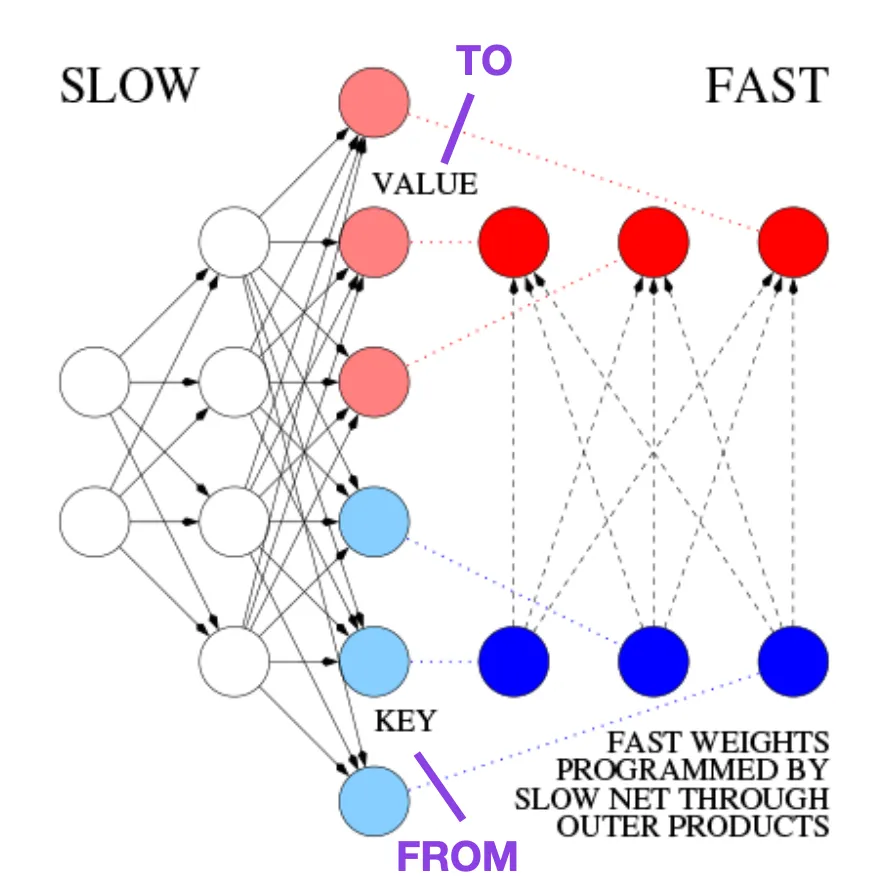

Learning to Control Fast-Weight Memories: An Alternative to Dynamic Recurrent Neural Networks (1991)

这篇文章推荐给那些对历史花絮和早期方法感兴趣的人,这些方法基本上类似于现代 Transformer。

例如,在比 Transformer 论文早 25 年的 1991 年,Juergen Schmidhuber 提出了一种递归神经网络的替代方案(https://www.semanticscholar.org/paper/Learning-to-Control-Fast-Weight-Memories%3A-An-to-Schmidhuber/bc22e87a26d020255afe91c751e5bdaddd8e4922),称为 Fast Weight Programmers (FWP)。实现快速权值变化的另一个神经网络是通过使用梯度下降算法缓慢学习的 FWP 方法中所涉及的前馈神经网络。

这篇博客 (https://people.idsia.ch//~juergen/fast-weight-programmer-1991-transformer.html#sec2) 将其与现代 Transformer 进行类比,如下所示:

在今天的 Transformer 术语中,FROM 和 TO 分别称为键 (key) 和值 (value)。应用快速网络的输入称为查询。本质上,查询由快速权重矩阵 (fast weight matrix) 处理,它是键和值的外积之和 (忽略归一化和投影)。我们可以使用加法外积或二阶张量积来实现端到端可微的主动控制权值快速变化,因为两个网络的所有操作都支持微分。在序列处理期间,梯度下降可以用于快速调整快速网络,从而应对慢速网络的问题。这在数学上等同于 (除了归一化之外) 后来被称为具有线性化自注意的 Transformer (或线性 Transformer)。

正如上文摘录所提到的,这种方法现在被称为线性 Transformer 或具有线性化自注意的 Transformer。它们来自于 2025 年出现在 arXiv 上的论文《Transformers are RNNs: Fast Autoregressive Transformers with Linear Attention 》(https://arxiv.org/abs/2006.16236)以及《Rethinking Attention with Performers》(https://arxiv.org/abs/2009.14794)。

2025 年,论文《Linear Transformers Are Secretly Fast Weight Programmers》(https://arxiv.org/abs/2102.11174)明确表明了线性化自注意力和 20 世纪 90 年代的快速权重编程器之间的等价性。

图源:https://people.idsia.ch//~juergen/fast-weight-programmer-1991-transformer.html#sec2

Seede AI

Seede AI

AI 驱动的设计工具

713

713

查看详情

查看详情

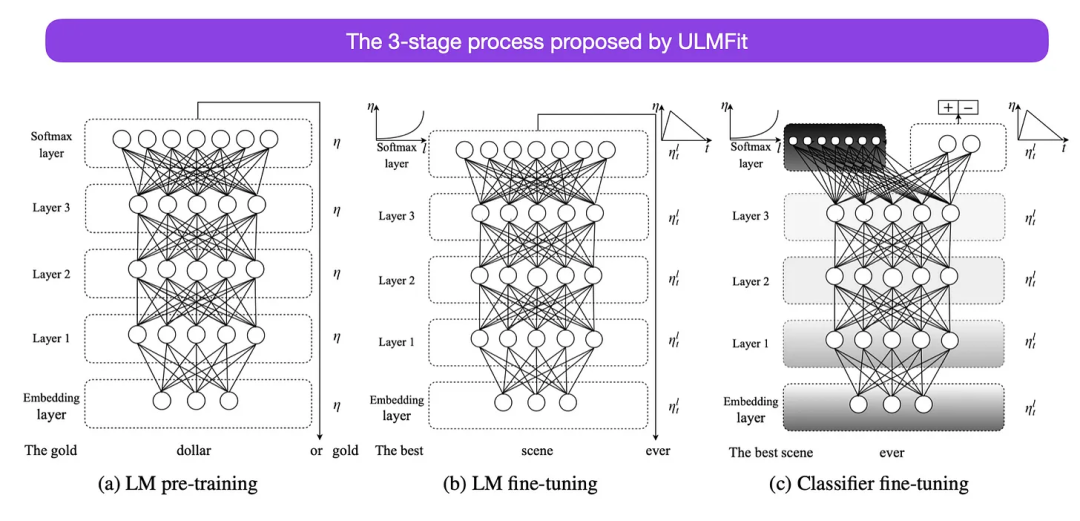

Universal Language Model Fine-tuning for Text Classification (2018)

这是另一篇从历史角度来看非常有趣的论文。它是在原版《Attention Is All You Need》发布一年后写的,并没有涉及 transformer,而是专注于循环神经网络,但它仍然值得关注。因为它有效地提出了预训练语言模型和迁移学习的下游任务。虽然迁移学习已经在计算机视觉中确立,但在自然语言处理 (NLP) 领域还没有普及。ULMFit(https://arxiv.org/abs/1801.06146)是首批表明预训练语言模型在特定任务上对其进行微调后,可以在许多 NLP 任务中产生 SOTA 结果的论文之一。

ULMFit 建议的语言模型微调过程分为三个阶段:

- 1. 在大量的文本语料库上训练语言模型;

- 2. 根据任务特定的数据对预训练的语言模型进行微调,使其能够适应文本的特定风格和词汇;

- 3. 微调特定任务数据上的分类器,通过逐步解冻各层来避免灾难性遗忘。

在大型语料库上训练语言模型,然后在下游任务上对其进行微调的这种方法,是基于 Transformer 的模型和基础模型 (如 BERT、GPT-2/3/4、RoBERTa 等) 使用的核心方法。

然而,作为 ULMFiT 的关键部分,逐步解冻通常在实践中不进行,因为 Transformer 架构通常一次性对所有层进行微调。

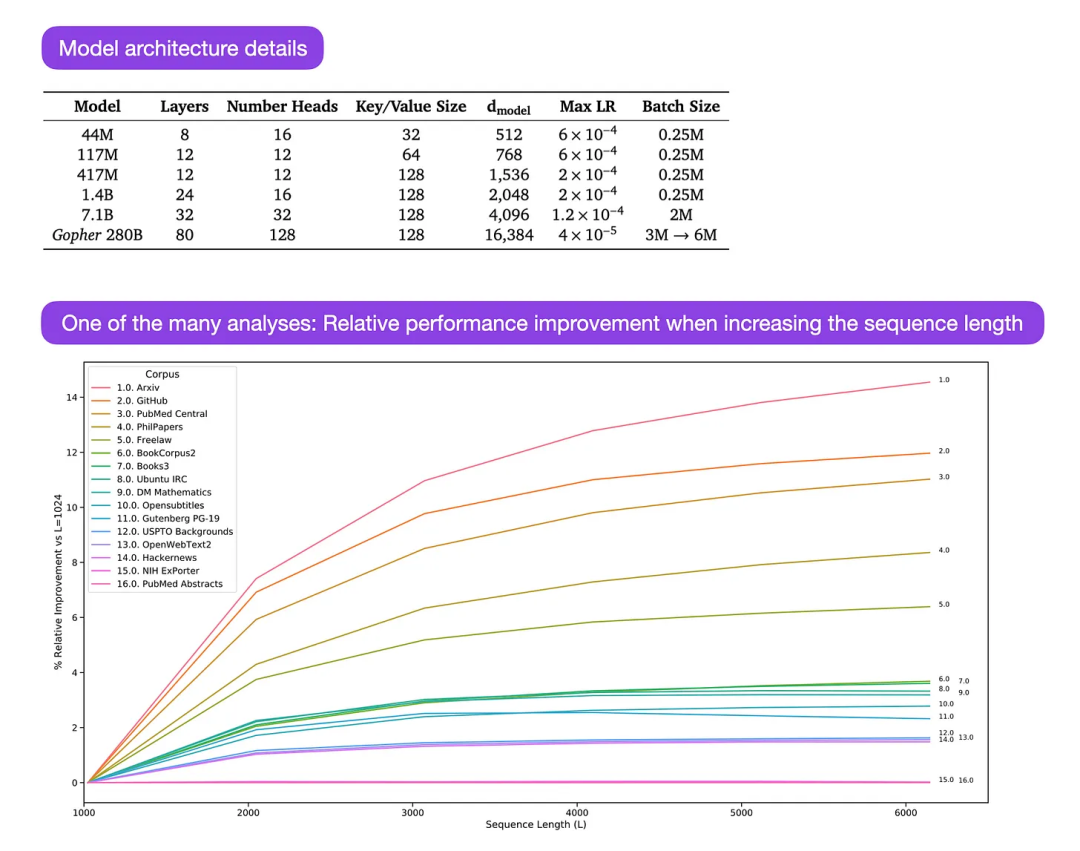

Gopher 是一篇特别好的论文(https://arxiv.org/abs/2112.11446),包括大量的分析来理解 LLM 训练。研究人员在 3000 亿个 token 上训练了一个 80 层的 2800 亿参数模型。其中包括一些有趣的架构修改,比如使用 RMSNorm (均方根归一化) 而不是 LayerNorm (层归一化)。LayerNorm 和 RMSNorm 都优于 BatchNorm,因为它们不局限于批处理大小,也不需要同步,这在批大小较小的分布式设置中是一个优势。RMSNorm 通常被认为在更深的体系架构中会稳定训练。

除了上面这些有趣的花絮之外,本文的主要重点是分析不同规模下的任务性能分析。对 152 个不同任务的评估显示,增加模型大小对理解、事实核查和识别有毒语言等任务最有利,而架构扩展对与逻辑和数学推理相关的任务从益处不大。

图注:图源 https://arxiv.org/abs/2112.11446

以上就是此「错」并非真的错:从四篇经典论文入手,理解Transformer架构图「错」在何处的详细内容,更多请关注其它相关文章!

# 架构

# 递归

# 开源

# 架构图

# 线性化

# 在何处

# 提出了

# 的人

# AI

# 大连seo教程如何赚钱

# 五金建材推广网站

# 泰安网站建设及优化

# 优化网站排名口碑

# 白山网页seo

# 平利县关键词排名推广

# 关键词排名优化技巧价格

# 宜宾网站建设略奥网络

# 文档模板网站建设公司

# 抚顺seo优化平台

# 但它

# 所示

# 被称为

相关栏目:

【

企业资讯168 】

【

行业动态20933 】

【

网络营销52431 】

【

网络学院91036 】

【

运营推广7012 】

【

科技资讯60970 】

相关推荐:

Nature封面:量子计算机离实际应用还有两年

全新小艺搭载AI大模型,有效提升学生和职场人士的工作效率

美图公司:Wink国内首发AI画面拓展功能

华为推出全新操作系统HarmonyOS 4,AI和新引擎完美融合

云深处科技绝影 Lite3 与 X20 四足机器人亮相

阿里云全面支持Llama2训练部署,助力企业快速构建自有大型模型

赋能选题探索:AI助手在经济学专业中的应用指南

百川智能发布Baichuan-13B AI模型,号称“130亿参数开源可商用”

小米9号员工李明宣布创业:打造首款安卓桌面机器人

解决导航“最后50米”难题 高德地图升级AR步行导航找终点功能

AI新视野,增长新势能,伙伴云受邀出席笔记侠创业讲真话AI峰会

助力人工智能产业高质量发展 龙岗区算法训练基地正式启用

遵义市首次引入手术机器人,成功实施全膝关节置换术

【|直播|预告】人工智能高峰论坛将于7月2日13:30准时开播!

Yann LeCun团队新研究成果:对自监督学习逆向工程,原来聚类是这样实现的

曝光HarmonyOS 4的重要新能力:全面升级AI大模型,小艺实现全面进化

DeepMind用AI重写排序算法;将33B大模型塞进单个消费级GPU

放弃自动驾驶,也是一种和解

软银、淡马锡、沙特阿美突击入股,“协作机器人第一股”节卡股份:强敌环伺,持续失血是常态

出门问问亮相2025世界人工智能大会,展示AI CoPilot解决方案

阿里云AI绘画创作大模型通义万相发布 已开启定向邀测

生成式人工智能如何改变云安全的游戏规则

Midjourney创始人:AI应该成为人类思想的延伸

搭载星火认知大模型 讯飞听见智慧屏开启AI办公新体验

人工智能如何与智能家居集成

AMD称下半年AI显卡供应充足,不需要像NVIDIA那样加价抢购

原小米 9 号员工李明打造全球首款 AI 安卓桌面机器人

OpenOOD更新v1.5:全面、精确的分布外检测代码库及测试平台,支持在线排行榜、一键测试

乐天派桌面机器人加入小米米家生态系统,实现与其他智能设备的互联

美踏控股推出创新人工智能大数据模型“心乐舞河”:虚拟人音舞社交的新体验

调查:过半数艺术家认为 AI 作图无法帮助他们的工作

关于开展“与AI共创未来”——2025年全国青少年人工智能创新实践活动的通知

揭示经济学论文写作中提高效率与质量的AI助手应用策略

如何用AI重塑你的工作流(一)

你们的开机第一屏画面要变了!安卓机器人首次3D化

羊驼家族大模型集体进化!32k上下文追平GPT-4,田渊栋团队出品

本届人工智能大会上的这个“镇馆之宝”,来自长宁企业西井科技!

华为HarmonyOS 4将集|成人|工智能大型模型

OpenAI正在评估内容审核功能以提高效率并减少人工干预

金融科技行业:2025年十大人工智能趋势预测

“思享荟”沙龙热议AIGC与元宇宙 复旦大学赵星畅谈深度数字化

人手一部「*」!视频版Midjourney免费可用,一句话秒生酷炫大片惊呆网友

烟台大学学生首次在全国大学生无人机航拍竞赛中获奖

可按用户语气自动回复消息,Zoom 推出基于生成式 AI 的新功能

科普:什么是AI大模型

AI室内设计软件流行,室内设计行业如何应对效率变革

2025“春晖杯”人工智能专场对接活动举办

京东 AI 大模型官宣 7 月 13 日发布,还有重磅合作

微软面向AI初学者推出免费网络课程

WHEE安装教程