Transformer架构已经横扫了包括自然语言处理、计算机视觉、语音、多模态等多个领域,不过目前只是实验效果非常惊艳,对Transformer工作原理的相关研究仍然十分有限。

其中最大谜团在于,Transformer为什么仅依靠一个「简单的预测损失」就能从梯度训练动态(gradient training dynamics)中涌现出高效的表征?

最近田渊栋博士公布了团队的最新研究成果,以数学严格方式,分析了1层Transformer(一个自注意力层加一个解码器层)在下一个token预测任务上的SGD训练动态。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

论文链接:https://arxiv.org/abs/2305.16380

Seede AI

Seede AI

AI 驱动的设计工具

713

查看详情

713

查看详情

这篇论文打开了自注意力层如何组合输入token动态过程的黑盒子,并揭示了潜在的归纳偏见的性质。

具体来说,在没有位置编码、长输入序列、以及解码器层比自注意力层学习更快的假设下,研究人员证明了自注意力就是一个判别式扫描算法(discriminative scanning algorithm):

从均匀分布的注意力(uniform attention)开始,对于要预测的特定下一个token,模型逐渐关注不同的key token,而较少关注那些出现在多个next token窗口中的常见token

对于不同的token,模型会逐渐降低注意力权重,遵循训练集中的key token和query token之间从低到高共现的顺序。

有趣的是,这个过程不会导致赢家通吃,而是由两层学习率控制的相变而减速,最后变成(几乎)固定的 token组合,在合成和真实世界的数据上也验证了这种动态。

token组合,在合成和真实世界的数据上也验证了这种动态。

田渊栋博士是Meta人工智能研究院研究员、研究经理,围棋AI项目负责人,其研究方向为深度增强学习及其在游戏中的应用,以及深度学习模型的理论分析。先后于2005年及2008年获得上海交通大学本硕学位,2013年获得美国卡耐基梅隆大学机器人研究所博士学位。

曾获得2013年国际计算机视觉大会(ICCV)马尔奖提名(Marr Prize Honorable Mentions),ICML2025杰出论文荣誉提名奖。

曾在博士毕业后发布《博士五年总结》系列,从研究方向选择、阅读积累、时间管理、工作态度、收入和可持续的职业发展等方面对博士生涯总结心得和体会。

揭秘1层Transformer

基于Transformer架构的预训练模型通常只包括非常简单的监督任务,比如预测下一个单词、填空等,但却可以为下游任务提供非常丰富的表征,实在是令人费解。

之前的工作虽然已经证明了Transformer本质上就是一个通用近似器(universal approximator),但之前常用的机器学习模型,比如kNN、核SVM、多层感知机等其实也是通用近似器,这种理论无法解释这两类模型在性能上的巨大差距。

研究人员认为,了解Transformer的训练动态(training dynamics)是很重要的,也就是说,在训练过程中,可学习参数是如何随时间变化的。

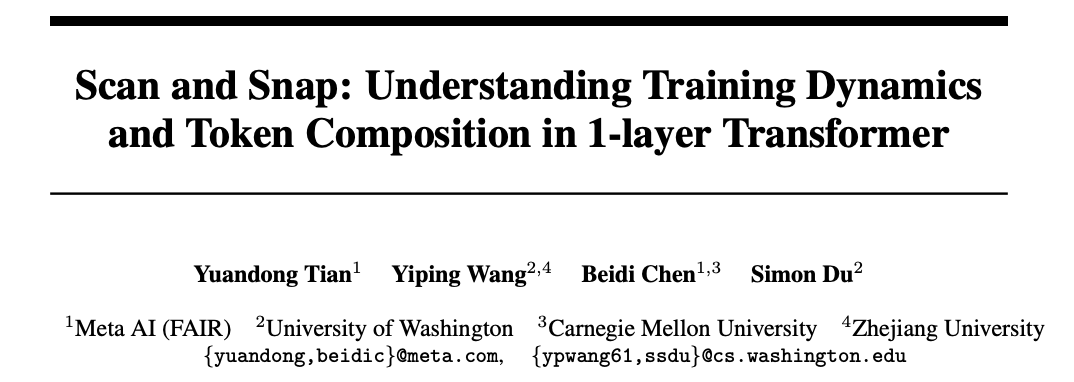

文章首先以严谨数学定义的方式,形式化描述了1层无位置编码Transformer的SGD在下一个token预测(GPT系列模型常用的训练范式)上的训练动态。

1层的Transformer包含一个softmax自注意力层和预测下一个token的解码器层。

在假设序列很长,而且解码器的学习速度比自注意力层快的情况下,证明了训练期间自注意力的动态行为:

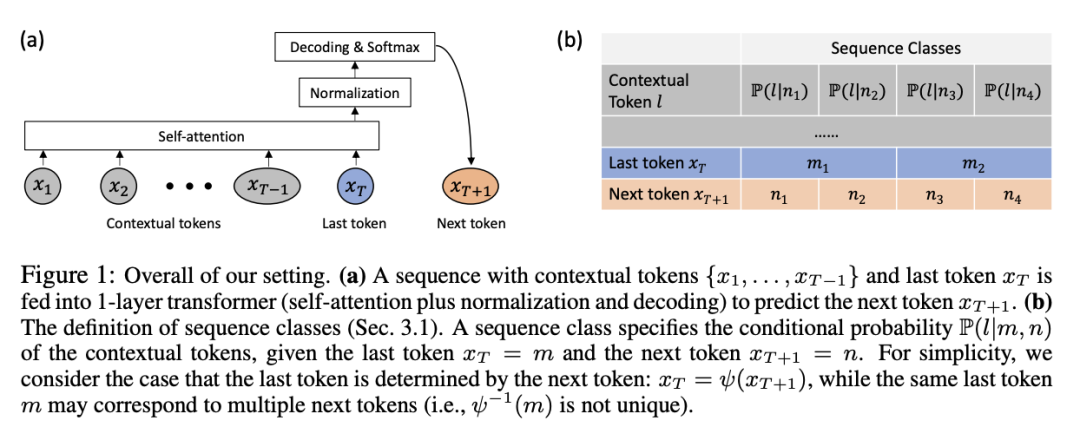

1. 频率偏差Frequency Bias

模型会逐渐关注那些与query token大量共现的key token,而对那些共现较少的token降低注意力。

2. 判别偏差Discrimitive Bias

模型更关注那些在下一个要预测的token中唯一出现的独特token,而对那些在多个下一个token中出现的通用token失去兴趣。

这两个特性表明,自注意力隐式地运行着一种判别式扫描(discriminative scanning)的算法,并存在归纳偏差(inductive bias),即偏向于经常与query token共同出现的独特的key token

此外,虽然自注意力层在训练过程中趋向于变得更加稀疏,但正如频率偏差所暗示的,模型因为训练动态中的相变(phase transition),所以不会崩溃为独热(one hot)。

学习的最后阶段并没有收敛到任何梯度为零的鞍点,而是进入了一个注意力变化缓慢的区域(即随时间变化的对数),并出现参数冻结和学会(learned)。

研究结果进一步表明,相变的开始是由学习率控制的:大的学习率会产生稀疏的注意力模式,而在固定的自注意力学习率下,大的解码器学习率会导致更快的相变和密集的注意力模式。

研究人员将工作中发现的SGD动态命名为扫描(scan)和snap:

扫描阶段:自注意力集中在key tokens上,即不同的、经常与下一个预测token同时出现的token;其他所有token的注意力都下降。

snap阶段:注意力全中几乎冻结,token组合固定。

这一现象在简单的真实世界数据实验中也得到验证,使用SGD在WikiText上训练的1层和3层Transformer的最低自注意力层进行观察,可以发现即使在整个训练过程中学习率保持不变,注意力也会在训练过程中的某一时刻冻结,并变得稀疏。

以上就是田渊栋新作:打开1层Transformer黑盒,注意力机制没那么神秘的详细内容,更多请关注其它相关文章!

# ai

# 上海

# 深圳市网站优化排名

# 如何精准推广人群营销

# 南宁建设网站建设

# 秭归网站推广哪家好

# 卓也小屋营销推广

# 网站优化权重2多长时间

# 怎么建设代刷网站?

# 全渠道推广实战网站

# 附子seo 百度云

# 微电影营销推广的优势

# 证明了

# 而对

# 较少

# 更快

# 谁能

# 是由

# 过程中

# 多个

# 开源

# kite

相关栏目:

【

企业资讯168 】

【

行业动态20933 】

【

网络营销52431 】

【

网络学院91036 】

【

运营推广7012 】

【

科技资讯60970 】

相关推荐:

国内阅读行业首款对话式AI应用“阅爱聊”封闭内测

不止“文心一言”,消息称百度将推出全新 AI 对话软件“万话”

RoboNeo安装教程

高通发布长期产品计划,为工业和企业物联网产品提供全新组合方案

下一个前沿:量子机器学习和人工智能的未来

Unity发布Sentis和Muse AI工具,助力创作游戏和3D内容

谷歌新安卓机器人logo曝光:头更大了

生成式AI爆发,亚马逊云科技持续专注创新,助力企业数字化转型

海柔创新携手SAP,以机器人技术助力全球客户升级数智化竞争力

消息称 ChatGPT 未来有望增加更多功能:上传文件分析信息,还能记住用户画像

苹果式 AI 哲学:不着一字,处处落子

陈根:AI工具为游戏软件实时3D内容助力

再也不怕「视频会议」尬住了!谷歌CHI顶会发布新神器Visual Captions:让图片做你的字幕助手

焊接协作机器人或将成为26届埃森展最大看点

2025 年开发者必须知道的六个 AI 工具

新华全媒+|AI:当心,我可能欺骗了你!

清华朱军团队新作:使用4位整数训练Transformer,比FP16快2.2倍,提速35.1%,加速AGI到来!

AI时代,企业需要什么样的员工?

美军AI无人机“误杀”操作员,人工智能要在军事领域毁灭人类?

AI大模型时代,数据存储新基座助推教科研数智化跃迁

人工智能如何用于家庭安全

中国电信AI能力通过国家级金融领域权威认证并荣膺AI国际头部竞赛冠军

让AI助手带您轻松愉快地享受写作之旅

生成式人工智能来了,如何保护未成年人? | 社会科学报

提升工作效率的智能工具:Zapier 让工作变得更简单!

微软最新推出的NaturalSpeech2语音合成模型:提供更准确的语音重构,避免棒读效果

中国气象局预测:到 2030 年,中国人工智能气象应用将达到国际领先水平

华为4G5G通信物联网收费标准公布,多年研发成果,十年花费近万亿

QQ音乐业内率先推出「AI一起听」功能,领取你的AI听歌助手

印象笔记开放旗下“印象 AI”,可一键生成思维导图、写文章等

Hugging Face发布了基于NASA卫星数据构建的AI地理空间基础模型

人工智能和神经网络有什么联系与区别?

本届人工智能大会上的这个“镇馆之宝”,来自长宁企业西井科技!

“思享荟”沙龙热议AIGC与元宇宙 复旦大学赵星畅谈深度数字化

能走、能飞、能游泳,科学家打造全能 M4 机器人

人工智能加速走进百姓生活:从2025全球人工智能技术大会看行业新趋势

中兴通讯无人机高空基站助力北京门头沟受灾乡镇保障应急通信

学界业界大咖探讨:AI对数字艺术创新的推动力

人工智能大胆预测:银河系至少有2万个地球,36种外星文明

世界人工智能大会高合发表演讲,HiPhi Y即将全球上市

提高开发效率:AmazonCodeWhisperer与Amazon Glue的集成和生成式AI的应用

全面拥抱大模型浪潮,ISC 2025打造全球首场AI数字安全峰会

探展WAIC | 第四范式“式说”聚焦toB大模型,布局生成式AI重构企业软件

B站内测 AI 搜索功能,输入“?”即可体验

小米发布CyberDog2 - 他们的第二代仿生四足机器人展示

金山办公宣布与英伟达团队合作,加速WPS AI服务

从谷歌到亚马逊,科技巨头们的AI痴迷

智能手机应用中的人工智能的重要性

视觉中国宣布推出AI灵感绘图、画面扩展功能

AI 冥想应用 Ogimi.ai 推出,可为用户提供教练级个性化指导